LangChain est une bibliothèque puissante qui permet de créer des applications basées sur le langage naturel en utilisant des modèles de langage avancés. L'un des aspects les plus intéressants de LangChain est sa capacité à intégrer divers outils pour enrichir les fonctionnalités des applications. Dans cet article, nous allons explorer les concepts d'outils et d'appels à outils dans LangChain, en nous appuyant sur des exemples concrets pour illustrer leur utilisation.

Qu'est-ce qu'un outil dans LangChain ?

Dans le contexte de LangChain, un outil est une fonctionnalité ou un service externe que le modèle de langage peut utiliser pour accomplir des tâches spécifiques. Ces outils peuvent inclure des API, des bases de données, des services de calcul, ou même d'autres modèles de langage. L'intégration de ces outils permet d'étendre les capacités du modèle de base, en lui permettant de réaliser des tâches qu'il ne pourrait pas accomplir seul.

Pourquoi utiliser des outils ?

L'utilisation d'outils dans LangChain présente plusieurs avantages :

Augmentation des Capacités : Les outils permettent au modèle de langage d'accéder à des informations en temps réel, de réaliser des calculs complexes, ou d'interagir avec d'autres systèmes.

Amélioration de la Précision : En utilisant des outils spécialisés, le modèle peut fournir des réponses plus précises et pertinentes.

Automatisation des Tâches : Les outils peuvent automatiser des tâches répétitives, libérant ainsi du temps pour des activités plus complexes.

Création d'un outils

Pour créer des outils, il est conseillé d'employer le décorateur

@tool. Conçu pour faciliter la création d'outils, ce décorateur est adapté à la majorité des situations. Une fois votre fonction définie, appliquez-lui le décorateur

@tool pour générer un outil conforme à l'Interface d'Outil.

Intégration de l'outil

Les modèles de langage de grande taille (LLM) peuvent être enrichis par l'intégration d'outils externes, permettant d'étendre leurs capacités au-delà de la simple génération de texte. En utilisant des interfaces standardisées comme celle proposée par LangChain, il est possible de connecter divers outils aux modèles LLM.

Il est important de noter que tous les modèles LLM ne sont pas nécessairement compatibles avec l'appel à outil, une évaluation préalable du LLM peut être nécessaire pour s'assurer de la compatibilité avec la fonctionnalité d'appel à outils.

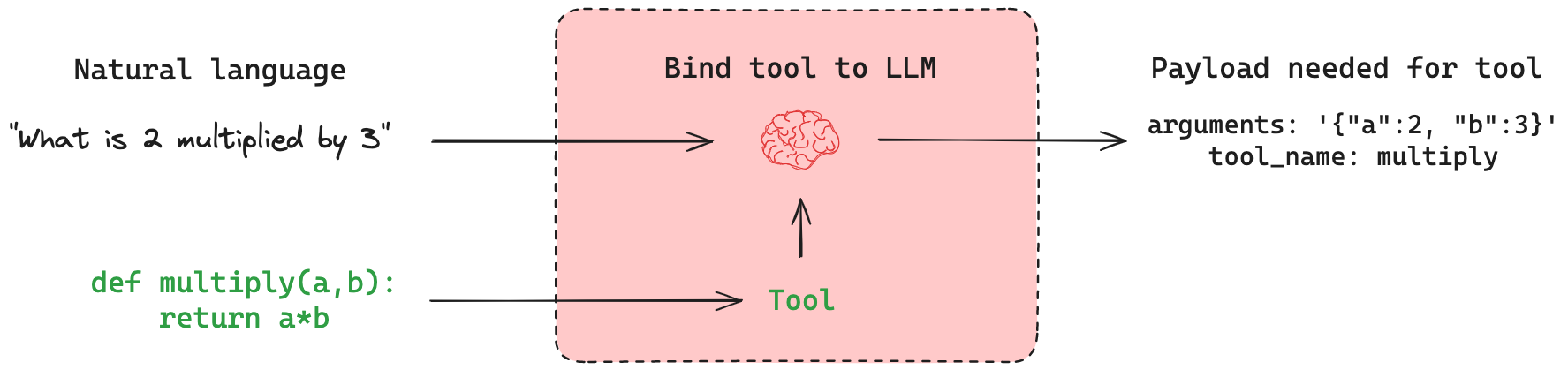

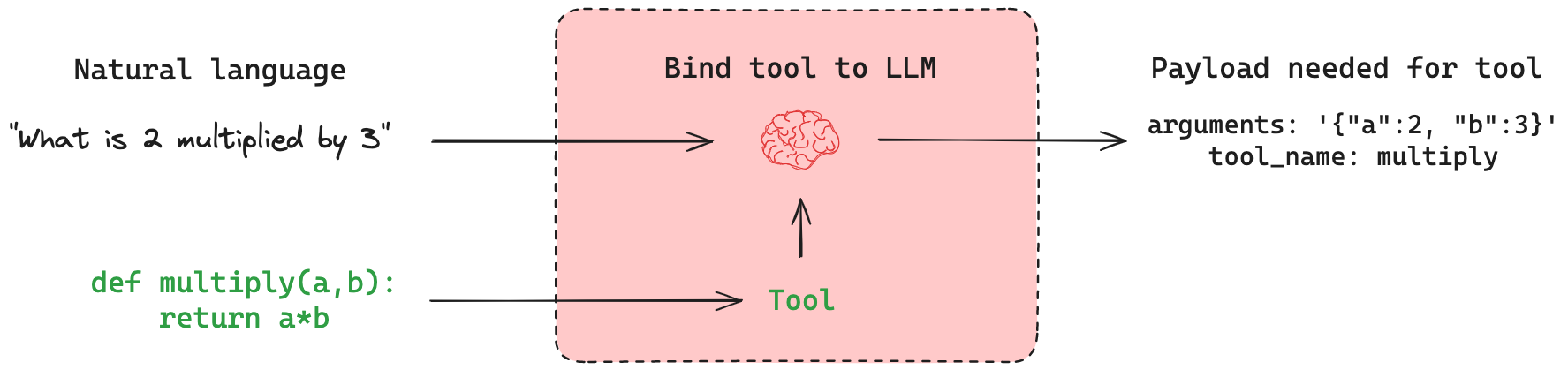

La méthode .bind_tools()

Premier appel au LLM : Lorsque l'utilisateur envoie le message "Hello world!", le modèle répond sans utiliser l'outil, car la demande ne nécessite pas de calcul.

Deuxième appel au LLM : Lorsque l'utilisateur demande "What is 2 multiplied by 3?", le modèle détecte qu'il doit utiliser l'outil multiplya=2b=3

Intégration des résultats dans le LLM

L'intégration des résultats des outils dans un modèle de langage est cruciale pour garantir une réponse fluide et pertinente. Lorsque le LLM appelle un outil, il doit être capable d'interpréter et d'intégrer les résultats obtenus dans sa réponse globale à l'utilisateur.

Processus d'intégration

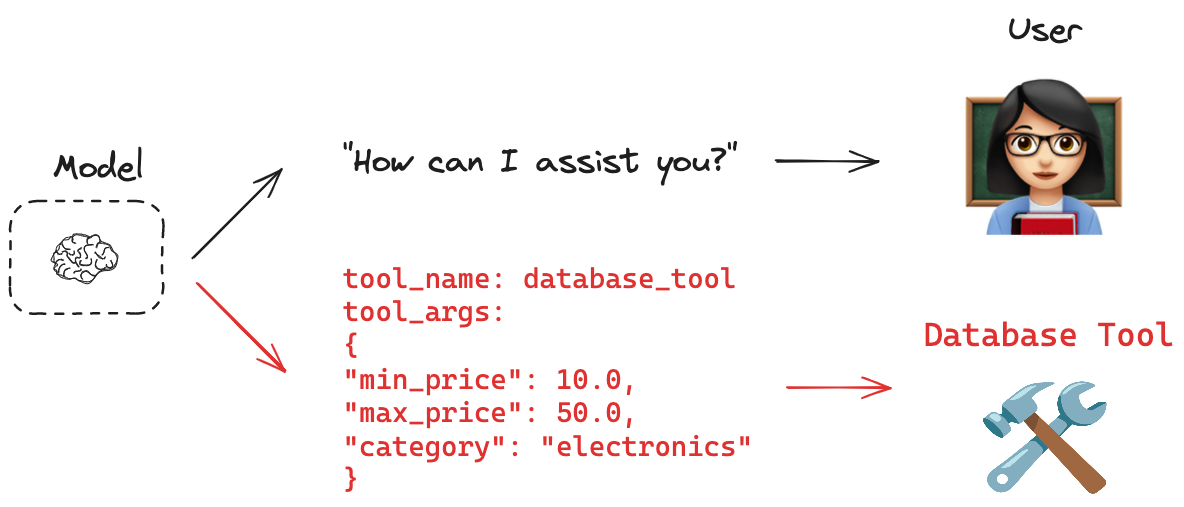

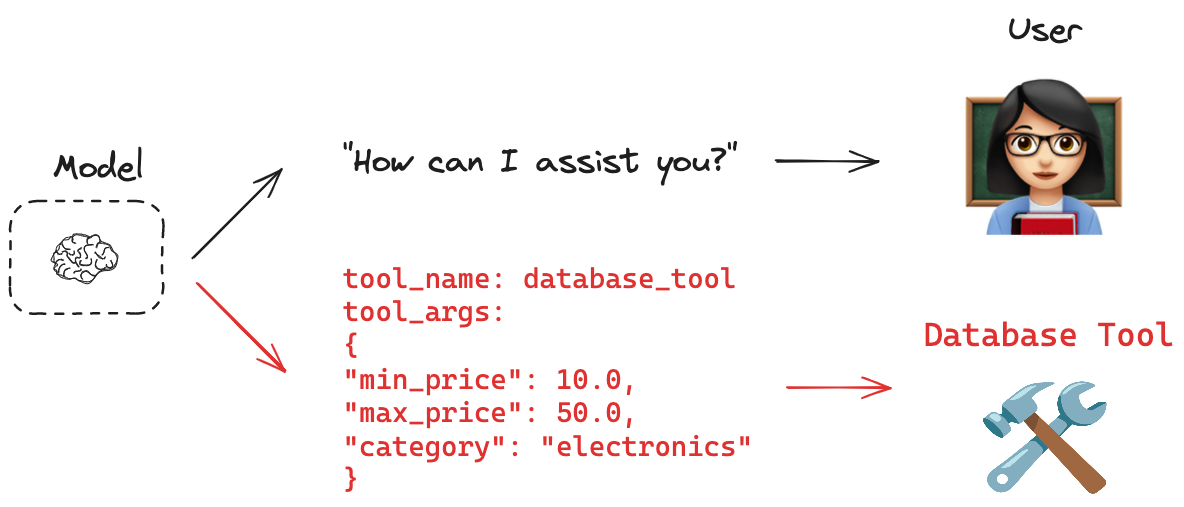

- Appel de l'outil : Le modèle évalue la requête utilisateur et décide si l'utilisation d'un outil est nécessaire. Si c'est le cas, il génère un appel à l'outil avec les paramètres requis.

- Obtention du résultat : L'outil retourne le résultat après avoir exécuté la tâche demandée. Ce résultat est ensuite renvoyé au modèle de langage.

- Synthèse de la réponse : Le modèle intègre le résultat de l'outil dans sa réponse. Le texte généré peut inclure des explications sur le processus ou simplement fournir le résultat attendu.

Exemple d'intégration

Imaginons que l'utilisateur demande : "Quel est le résultat de 5 multiplié par 7 ?". Le modèle appelle l'outil de multiplication, reçoit le résultat (35), et intègre ce chiffre dans une réponse du type : "Le résultat de 5 multiplié par 7 est 35." Cela permet de maintenir une conversation naturelle et informative.

Bonne pratiques

Pour concevoir des outils utilisables par un modèle, voici quelques recommandations :

- Les modèles avec des APIs d'appel d'outils dédiées sont plus efficaces que les modèles non optimisés.

- Les outils doivent avoir des noms et descriptions clairs pour une meilleure performance.

- Les outils simples et spécialisés sont plus faciles à utiliser que les outils complexes.

- Évitez de demander au modèle de choisir parmi une longue liste d'outils, cela peut être difficile pour lui.

Conclusion

En intégrant des outils dans LangChain, nous avons découvert comment augmenter les capacités des modèles de langage, les rendre plus précis et automatiser certaines tâches. La création d'outils personnalisés et leur intégration dans le système permettent d'étendre les fonctionnalités et de répondre efficacement aux besoins des utilisateurs. Les bonnes pratiques, telles que la clarté des descriptions d'outils et l'optimisation des APIs, assurent une utilisation fluide et une meilleure performance des modèles.

L'utilisation adéquate des outils et leur intégration dans les réponses du LLM offrent une expérience utilisateur enrichie, permettant de gérer des requêtes complexes avec aisance. Ainsi, l'utilisateur bénéficie d'une interaction plus naturelle et pertinente, où les résultats des calculs ou des requêtes sont intégrés de manière transparente.

En adoptant ces méthodes et pratiques, LangChain se positionne comme un outil puissant pour développer des applications intelligentes, optimisant l'interaction entre les utilisateurs et les modèles de langage. Les perspectives futures incluent une exploration plus approfondie des outils disponibles et une amélioration continue de leur intégration pour répondre aux besoins évolutifs du marché.