Artificial Intelligence

LLM

Maîtriser le Prompt Engineering : 3 techniques clés pour optimiser vos prompts

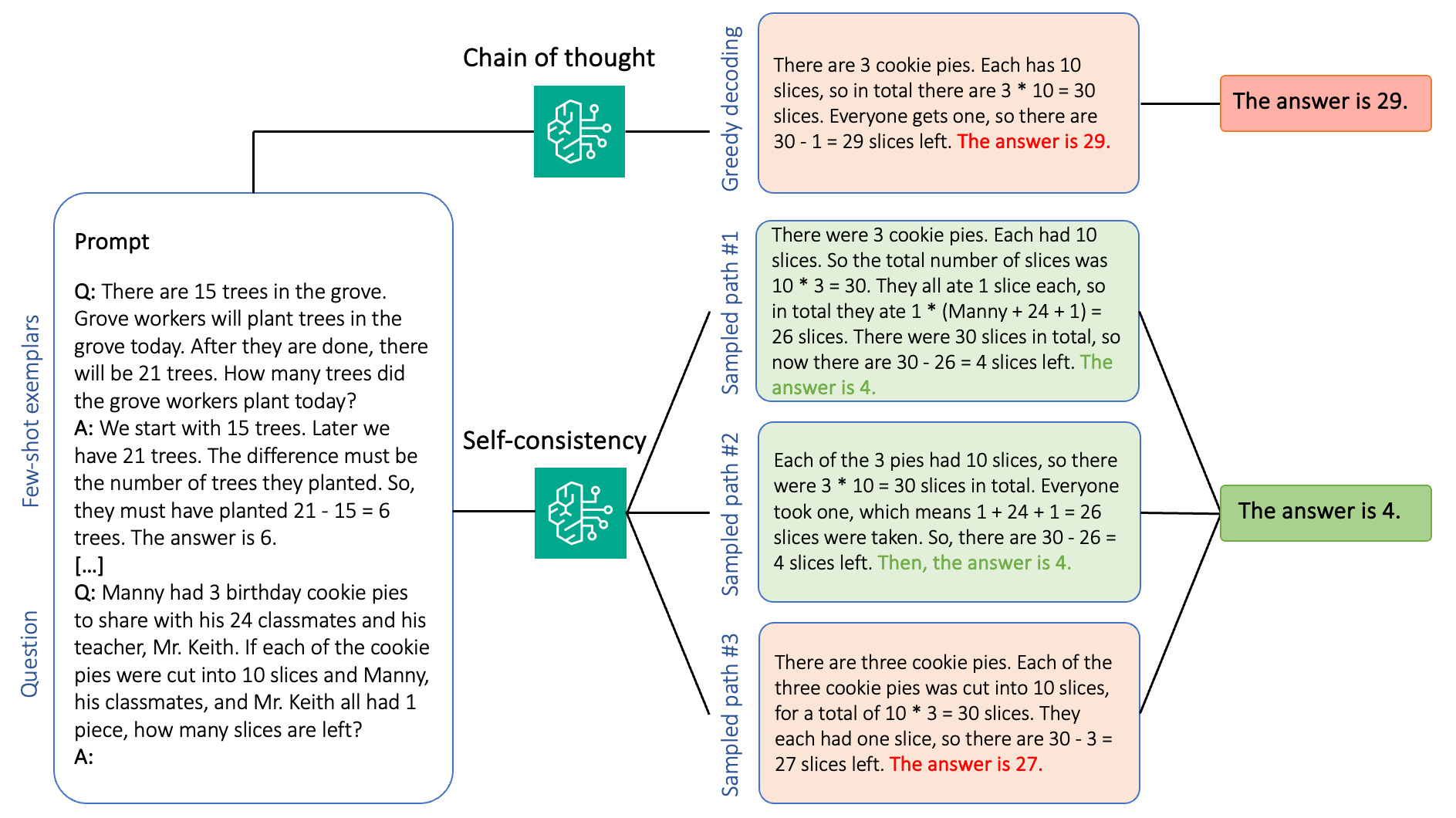

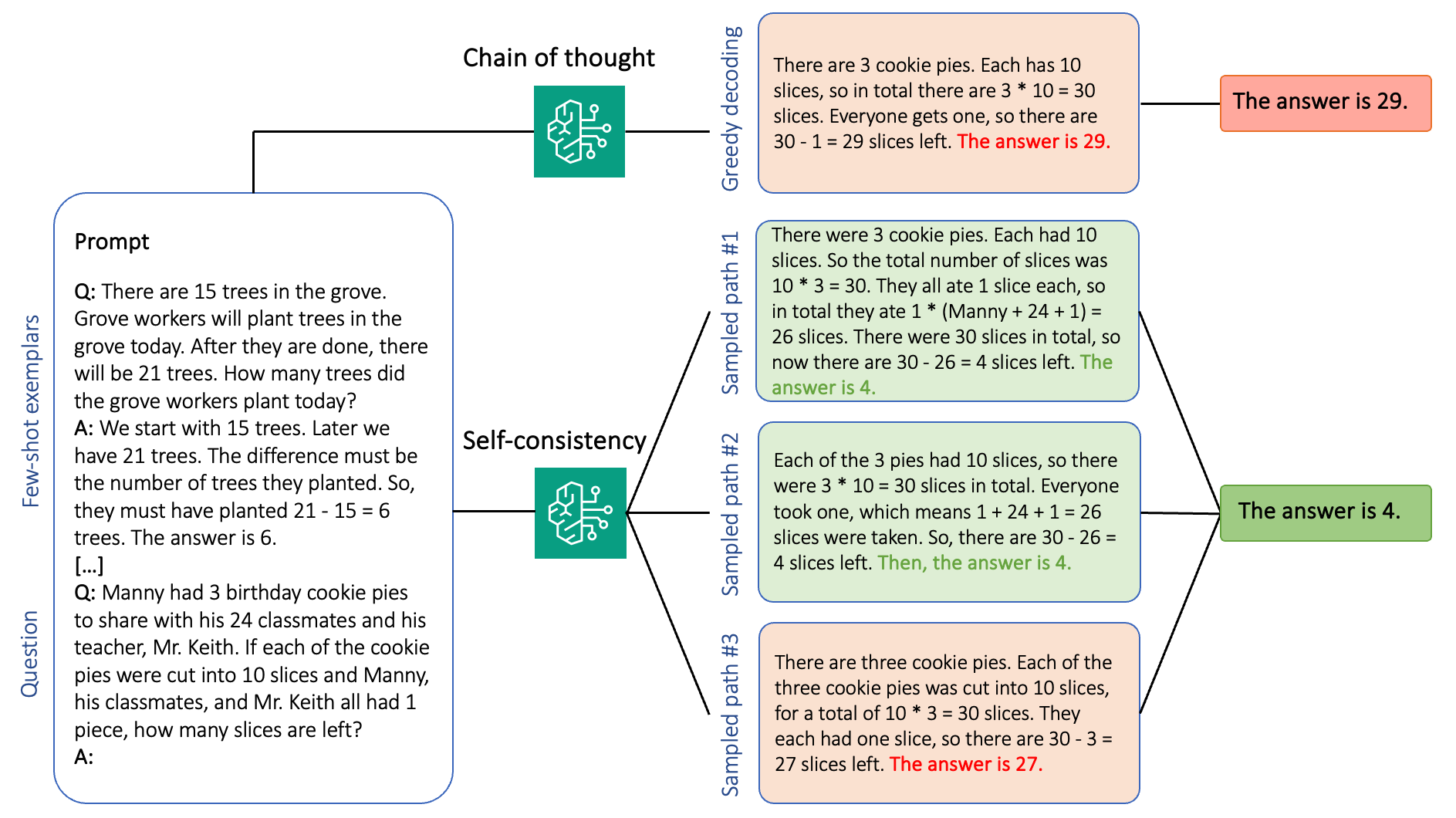

Dans le domaine du prompt engineering, il existe plusieurs techniques avancées qui permettent d’améliorer significativement la qualité des réponses générées par les modèles IA. Parmi celles-ci, les approches Few-Shot, Chain-Of-Thought, et Self-Consistency se démarquent par leur efficacité et leur adaptabilité. Explorons ces techniques en détail, en mettant en évidence leurs avantages et en fournissant des exemples concrets pour chaque méthode.

Partager avec

💙 Merci d'avoir parcouru l'article jusqu'à la fin !

Romain DE LA SOUCHÈRE - Lead Developer, Expert Cloud et DevOps

Ingénieur de formation avec plus de 11 ans d'expérience dans le développement back-end et le data engineering. Expert dans l’industrialisation des projets data dans le cloud.

» En savoir plus

Articles associés

Voir tous nos articles →

janvier 2, 2025

Divisez votre dataset avec train_test_split de scikit learn - Tutoriel pratique en PythonTemps de lecture : 12 min

avril 17, 2025

LLMs, prompts, agents IA… les nouveaux piliers de la compétitivité en entreprise en 2025Temps de lecture : 4 min

mai 22, 2025

Prompt engineering avancé : 7 patterns qui réduisent le coût tokenTemps de lecture : 10 min

Formations associés

Toutes nos formations →

Préparez la certification Azure AI‑102

20 heures

Débutant

Garantie

Préparez la certification PL‑300

24 heures

Débutant

Garantie

Préparez la certification AZ-900

10 heures

Débutant

Garantie

Préparez la certification DP‑700

24 heures

Débutant

Garantie

Préparez la certification DP‑900

10 heures

Débutant

Garantie

DataScientist.fr

By AXI Technologies

La certification qualité a été délivrée au titre des catégories d’actions suivantes :

- Actions de formation

Consulter le certificat© 2026 DataScientist.fr - AXI Technologies - Tous droits réservés